Skuteczne przygotowanie strony internetowej pod kątem Googlebot wymaga zrozumienia, jak działa proces indeksacji oraz jak zoptymalizować każdy element witryny, aby zapewnić pełne i szybkie przeszukiwanie zasobów. Optymalizacja pod SEO to nie tylko odpowiednie słowa kluczowe, lecz także prawidłowa struktura, konfiguracja plików konfiguracyjnych oraz wykorzystanie dedykowanych narzędzi. Poniższy przewodnik przedstawia kluczowe kroki oraz dobre praktyki związane z przygotowaniem witryny do efektywnej indeksacji.

Optymalizacja struktury witryny dla Googlebot

Prawidłowa architektura strony ma kluczowe znaczenie dla skutecznego crawl budget oraz dla łatwości poruszania się Googlebot po serwisie. Odpowiednio rozplanowana struktura przyspiesza indeksację i minimalizuje liczbę stron pominiętych.

- Hierarchia URL: Utrzymuj logiczny układ katalogów i nazwę ścieżek zgodnie z tematyką. Unikaj długich ciągów parametrów w adresach.

- Linkowanie wewnętrzne: Wdrażaj spójny system linkowanie wewnętrzne, który ułatwia dotarcie do głównych podstron. Korzystaj z menu, okruszków nawigacyjnych (breadcrumbs) i polecanych artykułów.

- Sitemap XML: Generuj mapa witryny automatycznie po każdej większej aktualizacji treści. Upewnij się, że plik jest umieszczony w root oraz zgłoszony w Google Search Console.

- Struktura nagłówków: Zadbaj o logiczne wykorzystanie

,

i kolejnych nagłówków w treści. Prawidłowa hierarchia ułatwia interpretację zawartości przez roboty.

- Unikanie duplikatów: Wprowadź canonicale w przypadku podobnych treści, aby skonsolidować sygnały SEO i uniknąć kanibalizacji słów kluczowych.

Dostosowanie treści i meta tagów

Treść pozostaje jednym z najważniejszych czynników rankingowych, ale niezbędne jest również prawidłowe zdefiniowanie meta danych. Dzięki temu Googlebot szybciej zrozumie tematykę strony i poprawnie ją sklasyfikuje.

- Meta tytuły i opisy: Twórz unikalne i zwięzłe meta tagi dla każdej podstrony. Tytuł powinien zawierać główne słowo kluczowe, a opis zachęcać do kliknięcia w SERP.

- Treść wysokiej jakości: Opracuj teksty, które rozwiązują problemy użytkowników i odpowiadają na ich pytania. Wprowadź czynniki LSI (Latent Semantic Indexing), aby zróżnicować semantykę.

- Formatowanie tekstu: Wykorzystaj listy, pogrubienia, podkreślenia (np. istotnych fragmentów) i akapity, aby poprawić czytelność i ułatwić robotom analizę struktury.

- Optymalizacja obrazów: Stosuj opisy alt oraz odpowiednie nazwy plików. Kompresuj grafikę, aby nie obciążać serwera i przyspieszyć prędkość ładowania.

- Wzbogacone dane (Schema.org): Dodaj JSON-LD lub inne formaty oznaczeń, aby wyświetlać rozszerzone wyniki w wyszukiwarce (rich snippets).

Techniczne aspekty i pliki konfiguracyjne

Efektywne wykorzystanie plików systemowych wpływa na sposób przeszukiwania i indeksowania zasobów. Należy zadbać o poprawność robots.txt oraz deklaracji w head każdej podstrony.

Plik robots.txt

- Określ, które katalogi mają być zablokowane przed Googlebot, np. zasoby administracyjne lub skrypty.

- Sprawdź poprawną lokalizację pliku w głównym folderze domeny.

- Dodaj link do sitemap.xml korzystając z polecenia Sitemap w pliku robots.txt.

Meta robots

- Wykorzystuj wartości noindex, follow, noarchive i inne zgodnie z potrzebami.

- Unikaj nadmiaru zakazów indeksacji, aby przypadkowo nie wykluczyć wartościowych podstron.

- Skontroluj ustawienia canonical, aby uniknąć konfliktów między meta robots a tagami kanonicznymi.

Prędkość i responsywność

- Zoptymalizuj kod CSS i JavaScript, łącz pliki oraz stosuj defer lub async dla skryptów zewnętrznych.

- Wdrażaj lazy loading dla obrazów i elementów multimedialnych.

- Zadbaj o mobile friendly charakter strony, korzystając z responsywnego lub adaptacyjnego designu.

- Monitoruj czas odpowiedzi serwera i wykorzystaj caching na serwerze oraz na poziomie przeglądarki.

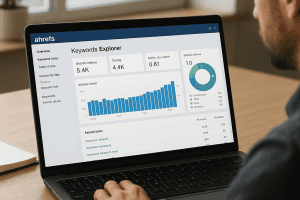

Narzędzia SEO ułatwiające monitorowanie i debugowanie

W procesie przygotowania i optymalizacji warto korzystać z dedykowanych rozwiązań, które pomogą w identyfikacji problemów oraz weryfikacji efektów działań.

- Google Search Console: Podstawowe źródło informacji o indeksacji, błędach crawl, danych Core Web Vitals oraz stanie sitemap.

- Google Analytics: Analiza ruchu organicznego, współczynnika odrzuceń i zachowania użytkowników.

- Ahrefs, SEMrush, Moz – kompleksowe platformy do śledzenia pozycji, audytów SEO, analizy linków zwrotnych i konkurencji.

- PageSpeed Insights, Lighthouse – narzędzia do oceny wydajności, dostępności oraz standardów PWA i SEO technicznego.

- Screaming Frog SEO Spider – desktopowy crawler, umożliwiający analizę struktury, meta danych oraz konfiguracji plików robots.txt i sitemap.

- GTmetrix, WebPageTest – dodatkowe testy szybkości ładowania oraz rekomendacje optymalizacyjne.