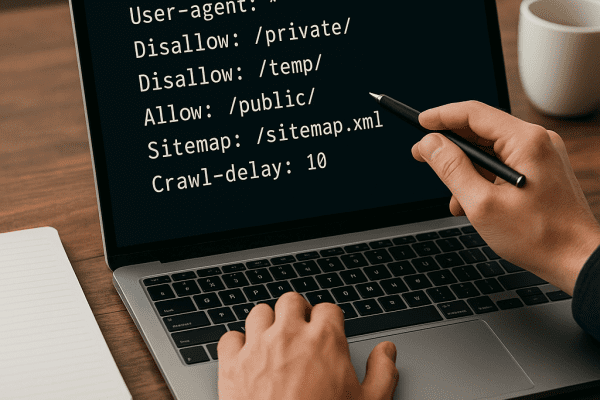

Jak optymalizować pliki robots.txt

Optymalizacja pliku robots.txt to jeden z podstawowych elementów strategii SEO. Właściwe skonfigurowanie tego pliku pozwala na efektywne zarządzanie procesem indeksowanie przez wyszukiwarki internetowe, minimalizowanie strat związanych z nadmiernym zużyciem crawl budget oraz precyzyjne kontrolowanie dostępu boty do kluczowych obszarów serwisu. Poniższy artykuł przedstawia najważniejsze informacje dotyczące tworzenia i optymalizacji tego narzędzia. Wprowadzenie do plików robots.txt Plik robots.txt to prosty dokument tekstowy…