Wprowadzenie

Efektywne zarządzanie treścią jest jednym z kluczowych elementów każdej strategii SEO. Jednym z najczęściej pomijanych aspektów jest problem duplikatów treści, który może znacząco obniżyć pozycje w wynikach wyszukiwania. W tym artykule omówimy metody wykrywania powielonych fragmentów, zaprezentujemy najpopularniejsze narzędzia wspierające audyt oraz przedstawimy najlepsze praktyki, które pomogą uniknąć kar ze strony wyszukiwarek.

Metody ręczne i audyty jakościowe

Podstawową formą analizy jest tradycyjny audyt ręczny. Mimo iż bywa czasochłonny, dostarcza szczegółowych wniosków o specyfice powielanych sekcji:

- Przegląd treści: Przejrzenie wszystkich istotnych podstron w celu wykrycia identycznych lub bardzo podobnych opisów.

- Analiza nagłówków: Sprawdzenie, czy nagłówki (H2, H3) nie powtarzają się bez modyfikacji.

- Ocenianie meta tagów: Powielone meta opisy i tytuły mogą świadczyć o skopiowanej strukturze SEO.

- Sprawdzenie linkowania wewnętrznego: Powtarzające się wzorce linków często towarzyszą wielokrotnemu wklejaniu fragmentów treści.

Korzyści z audytu ręcznego

Choć narzędzia potrafią znacznie przyspieszyć proces, audyt ręczny pozwala na:

- Lokalizację ukrytych powtórzeń w przypadku złożonych układów CSS i JavaScript.

- Ocena jakości kontentu pod kątem merytorycznym i stylistycznym.

- Identyfikację duplikacji wewnątrz podobnie zatytułowanych artykułów.

Narzędzia automatyczne do wykrywania duplikatów

Zautomatyzowane rozwiązania pozwalają szybko zidentyfikować powielone fragmenty między setkami lub tysiącami stron. Oto najpopularniejsze z nich:

- Screaming Frog SEO Spider – crawler potrafiący wyodrębnić powtarzające się meta tagi i nagłówki. Umożliwia eksport danych do CSV i prowadzenie zaawansowanej analizy.

- Copyscape – narzędzie online do porównania treści z innymi stronami w Internecie. Znajduje fragmenty, które zostały skopiowane z bazy innych serwisów.

- Sitebulb – zaawansowany crawler uwzględniający mechanizmy JavaScript. Pozwala przeszukać i wyróżnić zduplikowane fragmenty w kodzie oraz treści.

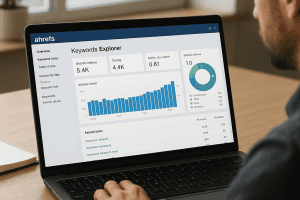

- Ahrefs – opcja „Content Gap” pozwala odkryć treści, które powtarzają się na Twojej witrynie i u konkurencji. Dodatkowo analizuje linkowanie wewnętrzne.

- SEMrush – Audyt SEO pokazuje, które strony mają podobne tytuły i opisy meta. Wskazuje powielone treści on-page i oferuje sugestie rozwiązania problemu.

- Google Search Console – raport „Stan indeksacji” informuje o ewentualnych problemach z indeksowaniem kanonicznych URL-i, co może wskazywać na duplikaty.

Jak korzystać z crawlerów

Optymalna konfiguracja crawlera jest kluczowa:

- Ograniczenie zakresu – wybór określonych podkatalogów lub URL-i, aby uniknąć zbyt szerokiego skanowania.

- Ustawienie reguł robots.txt – wykluczenie nieistotnych sekcji jak /wp-admin/ czy /wp-includes/.

- Delegowanie analizy – eksport raportu do narzędzi BI w celu przetwarzania dużych zbiorów danych.

Zapobieganie duplikatom i najlepsze praktyki

Po wykryciu duplikatów warto wprowadzić zmiany, które pomogą uniknąć powtórzeń w przyszłości. Oto sprawdzone strategie:

Użycie rel=canonical

Linki kanoniczne informują wyszukiwarki, która wersja strony ma być uznawana za główną. Stosuj:

- Rel=canonical na powielonych stronach wskazujące na oryginał.

- Automatyczne generowanie tagu w CMS, jeśli adres URL składa się z parametrów (np. sortowanie, filtry).

301 Redirects dla skasowanych stron

Jeżeli decydujesz się na usunięcie lub połączenie podstron, zastosuj przekierowania 301:

- Przekierowanie starego URL na nowy, z zaktualizowaną treścią.

- Monitorowanie błędów 404 w Google Search Console i naprawa przekierowań.

Tworzenie unikalnych treści

Aby zapobiec duplikatom:

- Twórz unikalne opisy produktów i kategorii.

- Wykorzystuj zespół redakcyjny do urozmaicania stylu i tonacji.

- Regularnie odświeżaj i rozbudowuj istotne artykuły, dodając nowe badania i multimedia.

Parametry URL i porządkowanie linkowania

Jeśli witryna generuje duże ilości URL-i różniących się tylko parametrami, zastosuj:

- Ujednolicenie adresów poprzez konfigurację CMS lub pluginy SEO.

- Zgłaszanie parametrów w Google Search Console jako nieistotnych do indeksacji.

- Optymalizację linkowania wewnętrznego, by główne strony miały najwięcej link juice.

Monitorowanie i raportowanie zmian

Regularne śledzenie efektów pozwala szybko reagować na nowe duplikaty:

- Comiesięczne skanowanie z wykorzystaniem crawlerów i narzędzi do porównywania treści.

- Raporty w formacie CSV lub integracje z BI dla menedżerów projektów.

- Alerty e-mailowe przy wykryciu powtarzających się bloków tekstu.

KPIs związane z duplikacją

Warto mierzyć:

- Liczbę wykrytych powtórzeń w porównaniu do poprzedniego okresu.

- Zmiany w liczbie zaindeksowanych stron (Google Search Console).

- Ruch organiczny poszczególnych podstron przed i po usunięciu duplikatów.

Ciągłe doskonalenie procesu

Stwórz procedury:

- Sprinty dedykowane kontroli jakości treści.

- Checklisty dla copywriterów i programistów, obejmujące wymogi unikalności.

- Okresowe szkolenia z zakresu dobrych praktyk SEO.